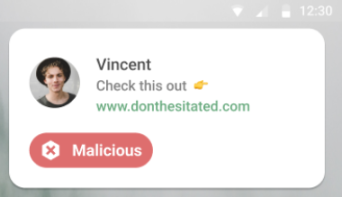

从上到下:URL 检查、加密货币地址检查、谣言检查。这类应用可以变得更个性化、用户自主且功能更强大。

这场较量不应是超级智能的超级说服者与你的对抗,而应是超级智能的超级说服者对抗你加上一个稍弱但仍属超级智能的、为你服务的分析器。

这是应该发生的情况。但它真的会发生吗?在《AI 2027》场景假设的短时间内,要实现信息防御技术的普及是一个非常困难的目标。但可以说,更温和的里程碑就足够了。如果集体决策最为关键,且如《AI 2027》场景所示,所有重要事件都发生在一个选举周期内,那么严格来说,重要的是让直接决策者(政客、公务员、部分企业的程序员及其他参与者)能使用良好的信息防御技术。这在短期内相对更易实现,且根据我的经验,许多这类人士已习惯与多个 AI 交流以辅助决策。

启示在《AI 2027》的世界里,人们想当然地认为,超级人工智能能够轻松迅速地消灭剩余人类已成定局,因此我们唯一能做的就是尽力确保领先的 AI 是仁慈的。在我看来,实际情况要复杂得多:领先 AI 是否强大到能轻松消灭剩余人类(及其他 AI),这一问题的答案仍有很大争议,且我们可以采取行动来影响这一结果。

如果这些论点正确,它们对当今政策的启示有时与 「主流 AI 安全准则」 相似,有时则不同:

延缓超级智能 AI 的发展仍是好事。超级智能 AI 在 10 年后出现比 3 年后更安全,30 年后出现则更安全。给人类文明更多准备时间是有益的。

如何做到这一点是一个难题。我认为,美国提议的 「10 年禁止州级 AI 监管」 被否决总体上是好事,但尤其在 SB-1047 等早期提案失败后,下一步行动方向变得不太明确。我认为,延缓高风险 AI 发展的侵入性最小、最稳健的方式可能涉及某种规范最先进硬件的条约。实现有效防御所需的许多硬件网络安全技术,也有助于验证国际硬件条约,因此这里甚至存在协同效应。

尽管如此,值得注意的是,我认为风险的主要来源是与军事相关的行为体,他们会极力争取豁免于这类条约;这绝不能被允许,若最终他们获得豁免,那么仅由军方推动的 AI 发展可能会增加风险。

让 AI 更可能做好事、更少可能做坏事的协调工作仍是有益的。主要例外情况(且一直如此)是:协调工作最终演变为提升能力。

提高 AI 实验室透明度的监管仍是有益的。激励 AI 实验室规范行为能降低风险,而透明度是实现这一目标的好方法。